El fundador de Meta enfrentó interrogatorio histórico al revelarse correos donde ordenó mantener filtros que generan dismorfia en niñas pese a advertencias internas.

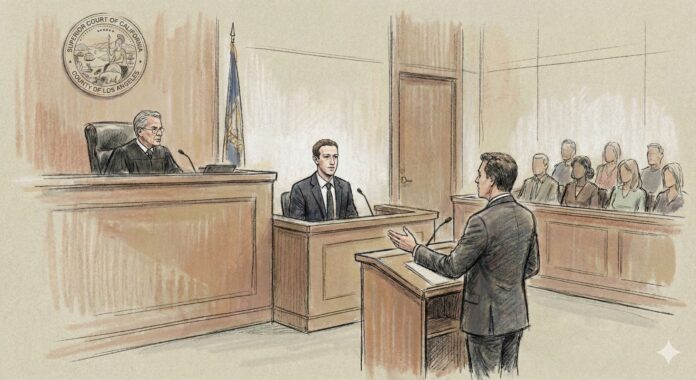

El silencio de la sala se quebró cuando Mark Zuckerberg juró decir verdad ante doce ciudadanos comunes investidos como jueces de un dilema tecnológico sin precedentes. No se juzgaba contenido publicado por usuarios, sino la arquitectura misma de las plataformas: su diseño deliberado para secuestrar atención infantil mediante mecanismos psicológicos probados.

En el centro del caso, Kaley —identificada legalmente como K.G.M.— relató cómo entre los seis y nueve años de edad quedó atrapada en el vórtice de scroll infinito, notificaciones intermitentes y filtros que distorsionaban su rostro. La exposición sostenida desencadenó depresión clínica, ansiedad incapacitante y pensamientos autodestructivos que persisten una década después. Su testimonio no es aislado: representa el destino de mil 600 demandas acumuladas que aguardan esta sentencia como faro jurisprudencial.

El abogado Mark Lanier desplegó ante el jurado el acrónimo interno ABC —Addicting Brains of Children— utilizado en memorandos corporativos para describir la estrategia de retención. Comparó las interfaces con salas de juego digital donde cada deslizamiento, cada vibración, cada efecto cosmético opera como una palanca de refuerzo variable, explotando la plasticidad neuronal en desarrollo.

El punto de máxima tensión llegó con la presentación de correspondencia fechada en 2019. Directivos alertaron a Zuckerberg y Adam Mosseri sobre evidencia interna: los filtros de “cirugía plástica” estaban generando trastornos de imagen corporal en adolescentes. Pese a las advertencias técnicas, documentos autenticados confirmaron que el CEO ordenó mantener activas esas herramientas. La prioridad declarada: preservar tiempo de permanencia frente a la competencia emergente de TikTok.

Bajo interrogatorio, el magnate admitió fallos en la detección temprana de menores de trece años, pero negó intencionalidad dañina en el diseño. “El sistema no es perfecto”, reconoció, sin embargo evadió responsabilidad sobre decisiones ejecutivas documentadas que sacrificaron bienestar psicosocial por métricas de engagement.

La apuesta legal trasciende este tribunal. Al enmarcar la demanda como “producto defectuoso” —similar a frenos fallidos en automóviles o tabaco ocultando cáncer—, los litigantes buscan perforar la Sección 230, escudo legal que por décadas blindó a plataformas de responsabilidad por daños estructurales. Un fallo favorable sentaría jurisprudencia global: las redes sociales dejarían de ser meros conductos neutrales para convertirse en fabricantes responsables de sus arquitecturas adictivas.

Mientras el jurado delibera, millones de pantallas siguen iluminando rostros infantiles con el mismo algoritmo cuestionado. La pregunta ya no es si engancha, sino quién pagará el precio de una generación marcada por interfaces diseñadas para no soltar.